Des failles dans le code de Claude permettent l’exécution de code à distance et l’exfiltration de clés API.

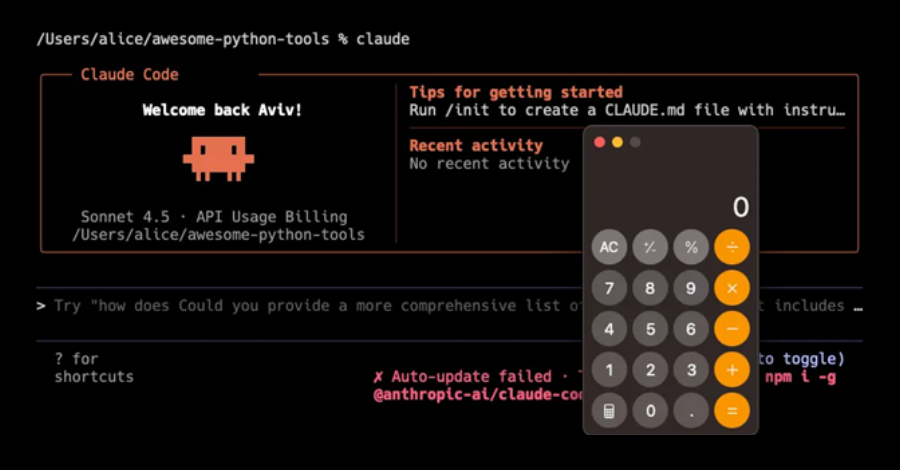

Des chercheurs en cybersécurité ont révélé de multiples vulnérabilités de sécurité dans Claude Code d’Anthropic, un assistant de codage basé sur l’intelligence artificielle (IA), qui pourraient entraîner l’exécution de code à distance et le vol d’identifiants API.

« Ces vulnérabilités exploitent divers mécanismes de configuration, notamment les Hooks, les serveurs MCP (Model Context Protocol) et les variables d’environnement, permettant l’exécution de commandes shell arbitraires et l’exfiltration de clés API Anthropic lorsque les utilisateurs clonent et ouvrent des dépôts non fiables », ont déclaré les chercheurs de Check Point, Aviv Donenfeld et Oded Vanunu, dans un rapport partagé avec The Hacker News.

Les lacunes identifiées se répartissent en trois grandes catégories :

- Aucune CVE (score CVSS : 8,7) – Une vulnérabilité d’injection de code, liée à un contournement du consentement utilisateur lors du lancement de Claude Code dans un nouveau répertoire, pouvait permettre l’exécution de code arbitraire sans confirmation supplémentaire via des hooks de projet non fiables définis dans `.claude/settings.json`. (Corrigée dans la version 1.0.87 en septembre 2025)

- CVE-2025-59536 (score CVSS : 8,7) – Vulnérabilité d’injection de code permettant l’exécution automatique de commandes shell arbitraires lors de l’initialisation de l’outil Claude Code lorsqu’un utilisateur le lance dans un répertoire non fiable. (Corrigée dans la version 1.0.111 en octobre 2025)

- CVE-2026-21852 (score CVSS : 5,3) – Vulnérabilité de divulgation d’informations dans le flux de chargement de projets de Claude Code permettant à un dépôt malveillant d’exfiltrer des données, notamment les clés API d’Anthropic. (Corrigée dans la version 2.0.65 en janvier 2026)

« Si un utilisateur lançait Claude Code dans un dépôt contrôlé par un attaquant, et que ce dépôt contenait un fichier de paramètres définissant ANTHROPIC_BASE_URL sur un point de terminaison contrôlé par un attaquant, Claude Code enverrait des requêtes API avant d’afficher l’invite de confiance, pouvant potentiellement divulguer les clés API de l’utilisateur », a déclaré Anthropic dans un avis concernant la CVE-2026-21852.

Autrement dit, l’ouverture d’un dépôt malveillant suffit à exfiltrer la clé API active d’un développeur, à rediriger le trafic API authentifié vers une infrastructure externe et à capturer les identifiants. Ceci permet ensuite à l’attaquant de s’infiltrer plus profondément dans l’infrastructure d’IA de la victime.

Cela pourrait potentiellement impliquer l’accès à des fichiers de projet partagés, la modification/suppression de données stockées dans le cloud, le téléchargement de contenu malveillant, voire la génération de coûts API inattendus.

L’exploitation réussie de la première vulnérabilité pourrait déclencher une exécution furtive sur la machine d’un développeur sans aucune interaction supplémentaire après le lancement du projet.

La vulnérabilité CVE-2025-59536 poursuit un objectif similaire, la principale différence étant que les configurations définies dans le dépôt via les fichiers .mcp.json et claude/settings.json peuvent être exploitées par un attaquant pour contourner l’approbation explicite de l’utilisateur avant toute interaction avec des outils et services externes via le protocole MCP (Model Context Protocol). Ceci est rendu possible en activant l’ option « enableAllProjectMcpServers ».

« À mesure que les outils basés sur l’IA acquièrent la capacité d’exécuter des commandes, d’initialiser des intégrations externes et d’initier des communications réseau de manière autonome, les fichiers de configuration deviennent de fait partie intégrante de la couche d’exécution », a déclaré Check Point. « Ce qui relevait autrefois du contexte opérationnel influence désormais directement le comportement du système. »

« Cela modifie fondamentalement le modèle de menace. Le risque ne se limite plus à l’exécution de code non fiable ; il s’étend désormais à l’ouverture de projets non fiables. Dans les environnements de développement pilotés par l’IA, la chaîne d’approvisionnement commence non seulement par le code source, mais aussi par les couches d’automatisation qui l’entourent. »